Çocukluk döneminde beyninin yarısı alınmış yetişkinleri inceleyen bilim insanları, beynin geri kalan yarısının kendini yeniden yapılandırdığını keşfetti.

Buna göre beyin geri kalan fonksiyonel beyin ağları arasında görülmemiş derecede güçlü bağlar kuruyor ve böylece kişinin beyni bütünmüş gibi işlev görmesini yardım ediyor.

Çalışma epilepsi nöbetlerini azaltmak amacıyla çocukken hemisferektomi ameliyatı olmuş 6 yetişkin ve 6 kontrol katılımcısıyla gerçekleşti.

12 katılımcının her birinden fonksiyonel manyetik rezonans görüntüleme (fMRI) tarayıcısına uzanması istendi.

Tarayıcı kan akışına bağlı değişiklikleri tespit ederek beyin aktivitesini ölçüyor.

Bu teknik beyindeki kan akışı ve sinirsel aktivitenin doğrudan birbirine bağlı olduğu gerçeğine dayanıyor. Beynin bir bölgesi kullanılırken o bölgeye kan akışı da aynı şekilde artıyor.

Hareketsiz duran katılımcılara araştırmacılar spontane beyin aktivitesini takip ederken uyumamaya çalışmaları söylendi.

Independent Türkçe'de yer alan habere göre, araştırma ekibi görme, hareket, duygu ve kavrama gibi süreçleri kontrol etmesiyle bilinen beyin bölge ağlarını inceledi.

Ayrıca Caltech Beyin Görüntüleme Merkezi'nde toplanan verileri, Brain Genomics Superstruct Projesi'nin yaklaşık bin 500 normal beyine ilişkin veritabanıyla karşılaştırdılar. Brain Genomics Superstruct Projesi, bilim insanlarının beyin fonksiyonu, davranış ve genetik çeşitlilikle ilgili verileri karşılaştırması ve araştırması için tasarlanmış bir proje olarak biliniyor.

Ekip normal beyne sahip insanlardaki ağlar beynin iki yarım küresini de kapladığı için tek yarım küreye sahip katılımcıların belli ağlarında daha zayıf bağlantılar bulacaklarını düşünüyordu.

Bunun yerine şaşırtıcı derecede normal küresel bağlantı ve kontrol katılımcılarının farklı ağlar arasındaki bağlantılarından daha güçlü bağlantılar buldular.

Kaliforniya Teknoloji Enstitüsü'ndeki doktora sonrası bilim insanı ve birinci yazar Dorit Kliemann şunları söyledi:

İncelediğimiz hemisferektomili insanlar önemli derecede yüksek işlevliydi. Dil becerileri bozulmamıştı. Onları tarayıcıya yerleştirdiğimde tıpkı taradığım yüzlerce başka kişiyle yaptığım gibi havadan sudan konuştuk. (...) Onlarla ilk kez karşılaştığınızda sağlık durumlarını unutabilirsiniz bile. Bilgisayarın önüne oturup MRI görüntülerinin beynin sadece yarısını gösterdiğini gördüğümde dahi bu görüntülerin daha az önce konuştuğunu, yürüdüğünü gördüğüm ve zamanını bu araştırmaya vakfetmeyi seçen aynı insandan geldiğine hayret ediyordum.

6 katılımcının tamamı çalışma sırasında 20'li yaşlarında veya 30'lu yaşlarının başındaydı ama hemisferektomi olduklarında yaşları üç aylıkla 11 yaş arasında değişiyordu.

Ameliyat geçirdikleri yaşların geniş aralığı, araştırmacıların beynin hasar gördüğünde kendini nasıl yeniden düzenlediğini incelemesine izin verdi.

Kliemann, “Bu farklı hemisferektomi hastalarının vakalarında beyin organizasyonunun nasıl mümkün olduğunu incelememize yardım edebilir ki böylece genel beyin mekanizmalarını daha iyi anlayabiliriz” dedi.

Üst düzey araştırmacı bilim insanı ve baş araştırmacı Lynn Paul'un idaresindeki Caltech'teki hemisferektomi araştırma programı, çeşitli beyin atipikliğine sahip kişilerde beynin nasıl geliştiğini, kendini düzenlediğini ve işlediğini daha iyi anlamak için çalışmayı genişletmeyi umuyor.

Kliemann sözlerini şöyle sürdürdü:

Yarım beyinle yaşayabilen kişilerin olması ne kadar dikkate değer bir durum olsa da bazen inme veya bir bisiklet kazasında alınan travmatik bir beyin hasarı veya tümör gibi çok küçük beyin lezyonlarının mahvedici etkileri olabiliyor. Kompensasyona götürebilecek beyin yeniden yapılanma ilkelerini anlamaya çalışıyoruz. Belki de gelecekte bu çalışma beyin hasarı olan daha çok kişiye yardım etmek için hedefe yönelik müdahale stratejilerini ve farklı sonuçlara dair senaryoları bilgilendirebilir.

Bu vaka çalışması Cell Reports adlı bilimsel yayında yer alıyor.

Bilim insanları yarısı alınan beynin kendini yeniden yapılandırdığını keşfetti

Araştırmacılar, beyinlerinin yarısı alınmış kişilerin, kalan ağlar kaybı telafi etmek için çalıştığı için "önemli derecede yüksek işlevli" olduğunu keşfetti (Reuters)

Bilim insanları yarısı alınan beynin kendini yeniden yapılandırdığını keşfetti

Araştırmacılar, beyinlerinin yarısı alınmış kişilerin, kalan ağlar kaybı telafi etmek için çalıştığı için "önemli derecede yüksek işlevli" olduğunu keşfetti (Reuters)

لم تشترك بعد

انشئ حساباً خاصاً بك لتحصل على أخبار مخصصة لك ولتتمتع بخاصية حفظ المقالات وتتلقى نشراتنا البريدية المتنوعة

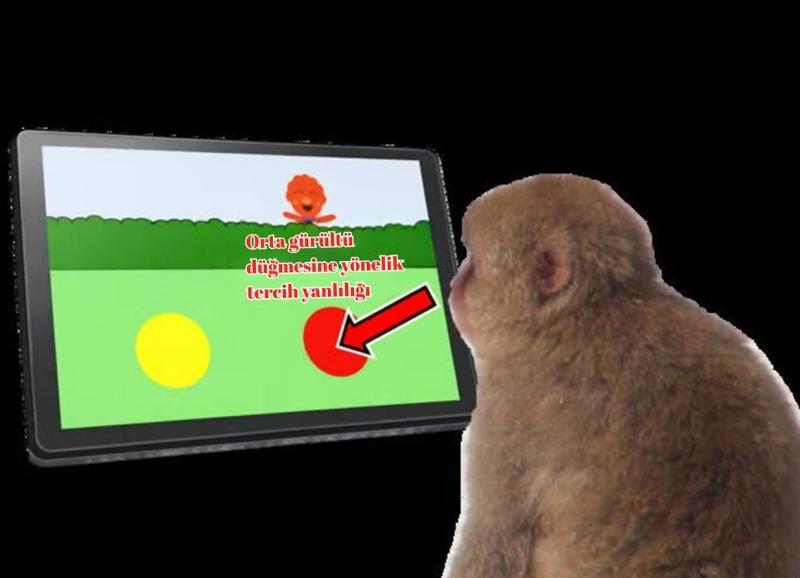

Video oyunu oynayan maymun (KyotoU/Sakumi İki)

Video oyunu oynayan maymun (KyotoU/Sakumi İki)