Florida’dan fırlatıldıktan yaklaşık 19 saat sonra, Amerikalı astronotlar Doug Hurley ve Bob Behnken'i taşıyan ve SpaceX’e ait olan Crew Dragon kapsülü, dün Uluslararası Uzay İstasyonu'na (ISS) ulaştı. Crew Dragon, 2011’den ISS’ye fırlatılma görevini gerçekleştiren insanlı tek ABD kapsülü oldu.

Reuters’ın haberine göre, milyarder Elon Musk'a ait uzay taşımacılığı şirketi SpaceX'in Cumartesi günü gerçekleştirdiği fırlatış, şirketin daha ucuz ve daha sık uçuş yapmak amacıyla ortaya çıkardığı yeniden kullanılabilir füze alanında yeni bir sıçramaya işaret ediyor.

İlk defa ticari bir şirket, NASA astronotlarını değil de ABD astronotlarını taşıyan uzay aracı geliştirip işletiyor.

AFP’nin haberine göre, bu yeni gelişme öncesinde, bu uçuşları daha güvenli ve uygun fiyatlı Rus Soyuz uzay araçları gerçekleştiriyordu.

Bu yüzden uzmanlar, SpaceX uçuşunu tekelin sonu olarak görüyor. Bundan sonra ISS’ye insan gönderen tek ülke Rusya olmayacak. Rusya’nın uzay programını yenilemesi gerektiği de ayrı bir gerçek.

Dokuz yıldır tüm astronotlar, ancak Rusya'da eğitim alıp Rusçayı öğrendikten sonra Baykonur Uzay Üssü’nden ISS’ye gidebiliyordu.

Rusya Federal Uzay Ajansı Roscosmos, SpaceX uzay aracının fırlatılmasını memnuniyetle karşıladı. Roscosmos Direktörü Sergey Krikalev, “Bu görevin başarısı, bizlere yeni olanaklar sağlayacak” dedi.

Ancak başarının Ruslara olan darbesi ağırdı. Fransız Ulusal Bilimsel Araştırmalar Merkezi uzay politikası uzmanı Isabelle Sourbes-Verger, “Bu uçuşlar Moskova'nın Soyuz üretmeye devam etmesi ve ISS konusundaki görüşmelerdeki önemli konumunu sürdürmesi hakkında beklenmedik bir fırsattı” dedi.

NASA’nın Roscosmos ile ISS’ye gönderilecek her astronot için bir koltuk edinmesi, 80 milyon dolara mal oluyordu. Moskova'daki Tsiolkovsky Uzay Akademisi uzmanı Andrei Ionin, SpaceX tüm ABD astronotlarını taşıyan tek şirket olduğu taktirde Roscosmos’un yılda en az 200 milyon dolar kaybedeceğini, bunun da bütçesine yaklaşık 2 milyar dolarlık önemli bir kayıp olarak yazılacağını vurguladı.

Roscosmos sözcüsü Pazar günü yaptığı açıklamada, ABD'nin hala Rusya'ya ihtiyacı olduğunu söyleyerek “İstasyona ulaşmak için en az iki seçeneğiniz olması önemli bir husustur, zirâ kimse neler olup bitebileceğini bilemez” dedi.

Elon Musk, bir koltuğun 60 milyon dolar fiyatında olacağını söylerken Roscosmos Başkanı Dmitriy Rogozin ise koltuk fiyatlarında yüzde 30 indirim uygulamak istediğini açıkladı.

Ionin ise “SpaceX, ucuz motorlar kullanıp neredeyse tüm parçalarını üreterek tasarruf sağlıyor. Rusya ise bunu yapmak için üretim sürecini değiştirmek zorunda kalacak. Biz uzay aracı fırlatma pazarını kaybettiğimiz vakit Roscosmos ise her şeyin yolunda olduğunu söylüyordu. Şimdi ise ellerindeki kartlar tükendi.

” dedi.

Başka bir seçenek NASA Başkanı Jim Bridenstine ise ABD uzay gemisindeki her bir Rus karşılığında Soyuz’de bir Amerikalı olacak şekilde takas sistemini öneriyor.

Daha geniş anlamda, Ionin’e göre, SpaceX gibi bir rakibin ortaya çıkması söylenenden çok daha kötü durumda olan Rus uzay endüstrisi için uyarı niteliğinde olmalıdır.

10 yıl önce Rusya, dünyadaki uzay aracı fırlatmalarının büyük bir kısmının gerisindeydi. Ancak Çin ve Space’ın rekabeti nedeniyle durum böyle değil.

Rusya'nın uzay sektörü, Uzak Doğu'daki yeni Vostoçni Uzay Üssü inşası hakkındaki birden fazla yolsuzluk skandalıyla gölgeleniyor.

Ionin’a göre uzay endüstrisinde büyük bir gelişme olmadan Sovyet teknolojisini değiştirmeye odaklanan Rusya, kaynak eksikliği ve gerçek siyasi iradenin yokluğu nedeniyle yenilik yapamıyor.

Mars'a ulaşmayı hedefleyen SpaceX gibi özel şirketlerin nüfuzundaki artış, yakalanması zor bir teknolojik sıçramadır.

Ionin, Rusya'nın yarışta kalması için uzay sektörünün ana oyuncularından bağımsız bir organının strateji geliştirmesi gerektiğini söyleyerek “ABD Başkanı Trump, bu konuda hedef belirlemek içi Ulusal Uzay Konseyini kurdu. Biz de aynı şeyi yapmalıyız” dedi.

Ancak bazı gözlemciler, askeri yetenekleri, özellikle de hipersonik füzeler geliştirmek için roket bilimi üzerine daha çok düşen Başkan Vladimir Putin'in siyasi irade eksikliğini hissediyorlar.

Bağımsı bir uzay uzmanı olan Vitaly Yegorov, “Devletin gücünü göstermek söz konusu olduğunda uzay araştırmaları Putin’in önceliği değildir” diyor.

ISS’ye dair ortak çalışmaların sona erdiği söylenirken Isabelle Sourbes-Verger ise Rusya'nın yeteneklerini paylaşarak konumunu yeniden kazanması için Mars’ın iyi bir fırsat olabileceğine değindi.

Ancak, bu tür herhangi bir görev maliyetinin çok yüksek olacağını ve bu kararı verecek siyasi bir tarafın olmadığı söyleyen Verger, bu yüzden şuanda dünyanın ikinci uzay gücü olan Çin'in de dahil edilmesi gerektiğini söyledi.

Ancak aynı zamanda “ABD Kongresi, Çin ile uzay işbirliğinde bulunmayı reddediyor” ifadelerini kullandı.

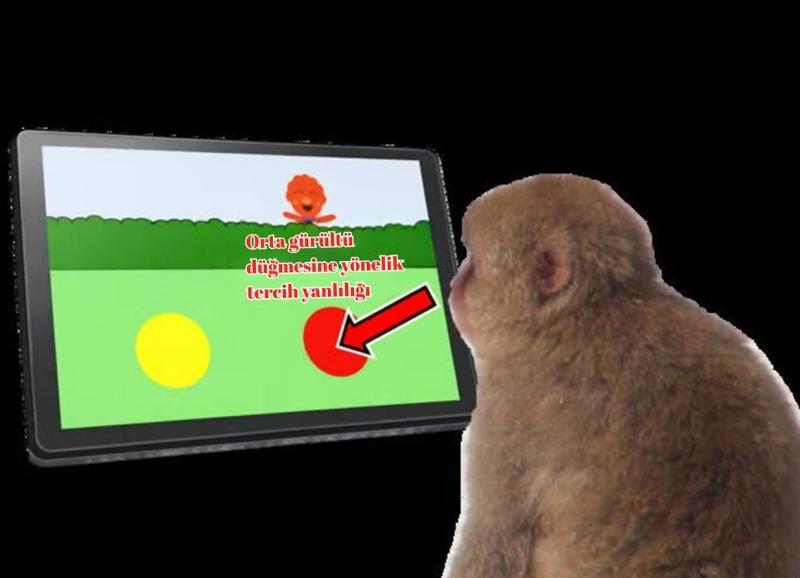

Video oyunu oynayan maymun (KyotoU/Sakumi İki)

Video oyunu oynayan maymun (KyotoU/Sakumi İki)