Gelişmiş cihazların işlem gücünü kullanan üretken yapay zeka araçları, uygulamaları ve hizmetleri verilere kolayca erişebiliyor, sonuçları daha hızlı analiz edebiliyor ve daha güvenli hale geliyor. Bu nedenle geliştiriciler bunları yaygın elektronik cihazlarda kullanmaya çalışıyor.

Bulut üretim platformları

Chat GPT sohbet robotunda kullanılanlar gibi üretken yapay zeka sistemleri, hizmet sağlayıcıların ve şirketlerin büyük veri merkezlerinde yer alıyor. Şirketler üretken yapay zeka hizmetlerinden yararlanmak istediklerinde, Microsoft 365 Copilot gibi bir yapay zeka platformuna erişim için ödeme yapıyor.

Ancak söz konusu bulut tabanlı sistemle ilgili tek sorun, onu çalıştıran büyük dil modelinin ve veri merkezlerinin, yalnızca uygulamaları çalıştırmak için değil, aynı zamanda büyük ve kurumsal veriler üzerinde üretken yapay zeka modellerini eğitmek için de gelişmiş GPU döngüleri ve büyük elektrik gücü tüketmesi. Ayrıca ağ bağlantısı sorunlarıyla da karşılaşabiliyor.

Bu nedenle üretken yapay zeka endüstrisi, büyük dil modellerini eğitmek ve çalıştırmak için gereken özel işlemcilerin eksikliğiyle de karşı karşıya.

Bu nedenle, danışmanlık firması J. Gould Associates'in kıdemli analisti Jack Gould ve bu alandaki diğer uzmanlar, üretken yapay zekanın gelişmiş cihazlara odaklanması gerektiğine inanıyor. Yani, önümüzdeki yıllarda odak noktası bilgisayarlar, tabletler, akıllı telefonlar ve hatta arabalar olacak ve bu da üretici yapay zeka uygulamalarının üreticilerinin işleme görevini veri merkezlerinden aktarmasına ve cihaz ile ağa bağlantının maliyetini ödeyen kullanıcı olduğu için ücretsiz kâr elde etmesine olanak tanıyacak.

Şarku’l Avsat’ın edindiği bilgilere göre üretken yapay zekanın dijital dönüşümü, bulut sektörünü geride bırakana kadar sektörün büyümesine katkı sağlıyor. Araştırma firması Gartner, 2025 yılına kadar şirketler tarafından yönetilen verilerin yüzde 50'sinin bir veri merkezi ya da bulut dışında işleneceğini ve üretileceğini öngörüyor.

Intel, Nvidia ve AMD gibi işlemci üreticileri ise dikkatlerini, gelişmiş cihazlardaki grafik işlem birimlerinin ve merkezi işlem birimlerinin üretken yapay zeka görevlerini yerine getirmelerine yardımcı olan küçük çipler (çip üzerinde sistem) ve sinirsel işlem birimleri üretmeye yönelttiler.

IDC'nin uluslararası araştırmalardan sorumlu başkan yardımcısı Rick Viars, Computer World dergisi tarafından bildirilen bir röportajda şunları söyledi:

“Üretken yapay zeka iPhone 15'te değil, iPhone 16'da, belki de Chat’in bir versiyonu olan ‘Apple GPT’ şeklinde ortaya çıkacak.”

Akıllı telefonlar

Apple GPT’nin önümüzdeki haziran ayında Apple'ın Dünya Çapında Geliştiriciler Konferansı'nda, yani şirketin iOS 18 işletim programının yeni sürümünü ve üretken yapay zeka kartlarıyla desteklenen tamamen yeni bir ‘Siri’ sürümünü açıklayacağı etkinlikte duyurması bekleniyor.

iPhone'un (ve diğer akıllı telefonların), ‘Google Pixel 8’ telefonundaki fotoğraflara adanmış ‘En İyi Çekim’ özelliği gibi üretken yapay zeka işlevlerini yerine getirecek çiplerin ortaya çıkışına tanık olması planlandığı tahmin ediliyor. Bu özellik, kullanıcının bir fotoğraftaki birinin yüzünü önceki bir fotoğrafta gösterilen yüzle değiştirmesine olanak tanıyor.

Viars açıklamasının devamında “Pixel, Amazon ya da Apple telefonlardaki bu işlemciler, gülmeyen birinin fotoğrafını asla çekmeyeceğinizi garanti ediyor çünkü diğer beş fotoğrafı kullanarak düzenleyebilir ve mükemmel fotoğrafı oluşturabilirsiniz” dedi.

Bu yönde bir hareket, üretken yapay zeka şirketlerinin düşüncelerini, sağlayıcının işin tüm maliyetini ödemesi gereken bir kıtlık ekonomisinden, destekleyicinin bazı temel görevlerin gelişmiş cihaz tarafından ücretsiz olarak yerine getirileceğini varsayabileceği bir bolluk ekonomisine kaydırmasına olanak tanıyacağı ifade ediliyor.

Windows – 12

Beklentiler, bu yılın sonunda piyasaya sürülecek olan bir sonraki Windows sürümünün (büyük olasılıkla Windows 12) gelişmiş cihazlarda üretken yapay zekanın benimsenmesi için bir katalizör görevi göreceği yönünde. Yeni işletim sisteminin yerleşik yapay zeka özellikleri içermesi de bekleniyor.

Üretken zeka için çipler ve işlemciler

Üst düzey cihazlarda yapay zeka kullanımı, masaüstü ve görüntü manipülasyonunun ötesine geçiyor ve Intel gibi çip üreticileri, cihazlara gömülü üretken yapay zekanın benimsenmesini hızlandırmak için endüstriyel, perakende ve sağlık hizmetleri gibi dikeyleri hedefliyor.

Örneğin, perakendeciler satış noktası ve dijital tabela sistemlerinde katalizör çiplere ve yazılımlara sahip olurken, sanayiciler operasyonları izlemek ve kusurları tespit etmek için robotik ve lojistik sistemlerinde üretken YZ ile güçlendirilmiş işlemciler kullanabiliyor. Ayrıca, doktorlar stres zamanlarında teşhis için yardımcı obstetrik YZ’den faydalanabiliyor.

Intel, geçtiğimiz aralık ayında duyurduğu ‘Ultra Core’ işlemcilerinin, önceki işlemcilerine kıyasla gerçek zamanlı sonografi uygulamalarında yapay zeka performansını yüzde 22 ila 25 oranında artırdığını iddia ediyor.

AMD Yapay Zeka Pazarlama Departmanı Başkanı Brian Madden konuya dair şunları söylüyor:

"Yapay zeka destekli uygulamalar, bilgisayarlar, dizüstü bilgisayarlar, endüstriyel sensörler, bir restorandaki küçük bir sunucu ve hatta bir sunucu gibi birçok gelişmiş cihazda giderek daha fazla kullanılıyor."

Bilimsel ve tıbbi araştırma sistemleri

Madden, üretken yapay zekanın ‘son elli yılın en dönüştürücü teknolojisi’ olduğunu savunuyor.

Aslında, üretken yapay zeka bilim, araştırma, endüstri, güvenlik ve sağlık gibi çeşitli sektörlerde kullanılmaya başlandı. Yeni ilaçların ve testlerin keşfinde, tıbbi araştırmalarda ve tıbbi teşhis ve tedavideki ilerlemelerde çığır açıyor.

Örneğin, bir AMD müşterisi olan Clarius, doktorların fiziksel yaralanmaları teşhis etmesine yardımcı olmak için üretken yapay zeka kullanırken, Japonya'nın Hiroşima Üniversitesi, doktorların bazı kanser türlerini teşhis etmesine yardımcı olmak için AMD çipleri tarafından desteklenen yapay zekaya başvuruluyor.

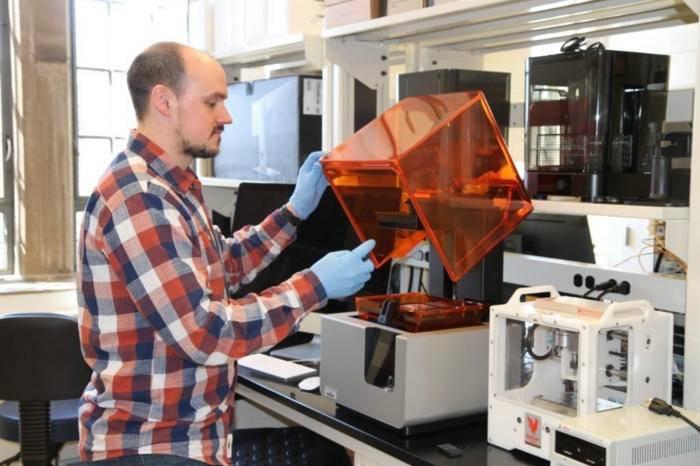

Virginia Tech Tarım ve Yaşam Bilimleri Fakültesi'nden Doçent Clément Vinauger (Virginia Tech)

Virginia Tech Tarım ve Yaşam Bilimleri Fakültesi'nden Doçent Clément Vinauger (Virginia Tech)