Çevirmenleri, yazarları ve tasarımcıları "işsiz bırakacağından" korkulan ChatGPT, her geçen gün el artırıyor ve tartışmanın içine farklı meslek gruplarını çekiyor.

ABD merkezli OpenAI firmasının geliştirdiği sohbet botu, yakın zamanda yapılan denemelerde prestijli hukuk, işletme ve hatta tıp sınavlarının birçok bölümünü geçmeyi başardı.

Son yılların en ses getiren yapay zeka araçlarından biri olan ChatGPT'nin yazdıkları halihazırda insanların yazdıklarından ayırt edilemez durumdaydı.

Öte yandan, sohbet botunun dünyanın dört bir yanında kabul gören zorlu sınavlarda başarı göstermesi, bazı uzmanlara göre, eğitim sisteminin gözden geçirilmesi gerekliliğini de doğurdu.

Geleceğin "iş insanları" makineler mi olacak?

ABD'nin en eski ve prestijli kurumlarından biri olan Pensilvanya Üniversitesi Wharton İşletme Okulu'ndan Prof. Dr. Christian Terwiesch, geçen hafta, ChatGPT'yle büyük yankı uyandıran bir deney yaptı.

Wharton'ın bitirme sınavına sokulan sohbet botunun en önemli bölümleri başarıyla tamamladığı görüldü.

Terwiesch, yaptığı deneyin sonuçlarını "Chat GPT3 Wharton MBA Derecesi Alır mı?" başlıklı makalesinde özetledi.

Açılımı "Master of Business Administration" (İşletme Yönetimi Yüksek Lisansı) olan MBA programları, iş insanlarına yönelik lisansüstü eğitim veren kurumları ifade ediyor.

Wharton da 142 yıllık tarihi boyunca birçok ünlü ismi ve iş insanını mezun etti. Bu kişiler arasında Donald Trump, Elon Musk ve yatırımcı Warren Buffet da yer alıyor.

Terwiesch'in yayımladığı makaleye göre, ChatGPT, özellikle operasyon yönetimi dersinde birçok öğrenciden daha iyi performans gösterdi. Operasyon yönetiminin, MBA programlarının en temel ve gerekli derslerinden olduğu biliniyor.

"Eğitim sisteminin gözden geçirilmesi gerekiyor"

Terwiesch, "ChatGPT, testlerden B ve B- arasında notlar aldı. Bunun işletme eğitimi için önemli etkileri olacak" ifadelerini kullandı.

Harf sisteminde en yüksek notun A olduğu düşünülürse sohbet botunun bu testlerde en yüksek ikinci notu aldığı anlaşılıyor.

Independent Türkçe'nin özel haberine göre, Michigan Üniversitesi Ross İşletme Okulu'ndan Prof. Dr. Jerry Davis, pazartesi günü meslektaşının bu deneyini tartışmak üzere fakültede bir toplantı düzenledi.

"Ben alarm zillerini çalanlardan biriyim" diyen Davis, Financial Times'a verdiği röportajda şu ifadeleri kullandı:

"Durum giderek daha da zorlaşacak. Eğitim sistemini tepeden tırnağa yeniden düşünme zamanı."

Geliştirilen araçlar işe yaramadı: Yazdığı makaleler ayırt edilemiyor

ChatGPT'nin arkasında, OpenAI'ın 2020'den beri üzerinde çalıştığı yapay zeka dil modeli GPT-3 var.

GPT-3, verileri işlemesini sağlayan 175 milyar parametreye sahip. Bu da onu şimdiye dek piyasaya sürülen en büyük dil modeli haline getiriyor. İkinci sırada ise Microsoft'un GPT-3'ten hemen önce tanıttığı Turing NLG adlı model geliyor. Bu da 17 milyar parametreye sahip.

GPT-3, 2021'den beri ABD'deki kullanıcılara açıktı. Bu yüzden öğrencilerin ödevlerini ve sınavlarını yapay zeka sayesinde geçtiğine dair haberler ChatGPT'nin yayımlanmasından önce gelmeye başlamıştı.

Ancak geçen yıl sonunda ChatGPT'nin de tüm dünyadan kullanıcılara açılması, bu haberleri de çoğalttı ve hızlandırdı. Böylece akademi camiası, yapay zekaya yazdırılan makalelerin nasıl tespit edilebileceğini tartışmaya başladı.

Son aftalarda ChatGPT'de yazılan yazıları tespit etmek, hilelerin ve intihallerin önüne geçmek üzere yeni araçlar da geliştiriliyor.

Örneğin, Princeton Üniversitesi bilgisayar bilimleri öğrencisi Edward Tian, bu amaçla GPTZero adlı bir başka yapay zeka algoritması geliştirmişti. Ancak yapılan denemeler, bu aracın da yeterince güvenilir sonuç vermediğini ortaya çıkarmıştı.

Öğrencilerden daha iyi olduğu için tespit etmek mümkün olabilir

Öte yandan, bu süreçte bazı akademisyenler, kendi öngörü yeteneklerine dayanarak birçok hileyi tespit etmeyi başardı. Örneğin Kuzey Michigan Üniversitesi'nden felsefe profesörü Antony Aumann, burka yasaklarıyla ilgili şüphe uyandıracak kadar tutarlı ve iyi yazılmış bir ödevin ChatGPT tarafından üretildiğini fark edebildi.

Aumann şüphelendiği makaleyi öğrenciye yeniden yazdırdı. Bunun ardından öğrenci, makaleyi yapay zekaya yazdırdığını itiraf etti.

Bazı akademisyenlere göre, en azından şimdilik ChatGPT'yi tespit etmenin tek yolu, akademisyenlerin hisleri. Zira yapay zeka çıktısı "makaleler fazla iyi yazılabiliyor".

Kadir Has Üniversitesi'nde Akademik İngilizce alanında dersler veren öğretim görevlisi Turgay Bayındır, ChatGPT'ye yazdırdığımız bir 5 paragraflık bir İngilizce makaleyi yorumlarken şöyle söylemişti:

"Bu aslında eksiği olmayan bir essay. İngilizcesi de çok iyi. Ama benim aklıma en azından ana dili İngilizce olmayan birinin bunu yazamayacağı geliyor."

Üniversitede yasaklar dönemi: Sözlü sınavlara dönüş başlayabilir

Londra'daki Imperial College İşletme Okulu'nun dekanı Francisco Veloso, "ChatGPT'den kurtulmak için" ciddi çalışmalar yaptıklarını söylüyor. Financial Times'a konuşan Francisco, yakında bununla ilgili politikalar geliştireceklerini belirtti:

El yazısı çalışmalara geri dönebiliriz. Bunun yanı sıra daha fazla sözlü sınava ve sınıf içi çalışmaya başvurabiliriz.

Bu arada sohbet botu ABD'nin New York kentindeki okullarda yasaklandı. Okullardaki internet bağlantılarında ve cihazlarda ChatGPT'ye erişim önceki haftalarda engellendi.

Yetkililer botun yanlış bilgi verebileceğini ve kopya için kullanılabileceğini, bu sebeple öğrencilerin eğitimine zarar vermesinden endişelendiklerini savunuyor.

Dil modellerinin "matematiği çok kötü"

Wharton'da yapılan deneyde aslında ChatGPT gibi araçların önemli bir açığı ortaya çıkarıldı.

Prof. Dr. Terwiesch,ChatGPT'nin operasyon yönetimi ve süreç analiziyle ilgili sorulara doğru ve analitik cevaplar verdiğini kanıtlamış olsa da, sohbet botunun sayısal becerilerinin çok sınırlı olduğu sonucuna vardı. Bu yüzden botun muhasebe sınavlarını geçmesi mümkün olmayabilir.

"Kelimelerin güzelliği karşısında şaşkına döndüm; özlü kelime seçimi, yapı… Bunlar kesinlikle harikaydı" diyen akademisyen, şöyle ekledi:

"Ama matematik çok korkunçtu. Dil ve sezgi doğru, fakat görece basit bir ortaokul matematiğini bile yapamamıştı."

Yapay zeka dil modellerinin matematikle imtihanını gündeme taşıyan bir diğer gelişme de gazetecilik alanında yaşanmıştı.

Önceki haftalarda, teknoloji sitesi CNET'in bir süredir gizlice yapay zeka yazımı haberler yayımladığı ortaya çıkmıştı. Dahası bu haberlerin yanlış bilgiler içerdiği tespit edilmişti.

Özellikle ekonomi haberlerindeki faiz hesapları fazla abartılıydı ve okuru yanlış yatırıma yönlendirme potansiyeline sahipti.

Bu durum, yapay zeka araçlarının matematikle ilgili bir sorunu olduğu fikrini doğururken, CNET de haberlere "Yapay zeka tarafından yazılmıştır" uyarısı eklemeye ve yanlışlıkları düzeltmeye başladı.

ABD'deki Tıbbi Lisans Sınavı'nda da iyi performans gösterdi

ChatGPT'nin matematiği kötü ama biyoloji bilgisi için aynı şey söylenemiyor. Zira sohbet botu ABD'deki Tıbbi Lisans Sınavı'nda da birçok bölümü geçmeyi başardı.

Ülkedeki tüm tıp fakültesi mezunları, lisans sahibi olmak ve çalışmaya başlamak için üç bölümden oluşan bu sınavı vermek zorunda.

ChatGPT'yi bu sınava tabi tutan bir grup araştırmacı, botun bazı testlerde sınavı geçme eşiğine ulaştığını, bazı testlerde de bu eşiğe çok yaklaştığını duyurdu.

Öte yandan bu durum, tıp dünyasını alarma geçirmiş gibi görünmüyor. Hatta bazı uzmanlar bu gelişmelerden memnuniyet duyuyor. Buna göre, ChatGPT gibi büyük dil modelleri, doktorlara karar verme sürecinde yardımcı olma potansiyeline sahip.

Örneğin, Ansible Health adlı bir klinikteki doktorlar, hastaların durumlarını daha iyi anlamak için karmaşık tıbbi raporları basitleştirmek gibi görevlerde ChatGPT'yi denemeye şimdiden başladı.

Google'ın yapay zekasının tıp bilgisi doktorlarla aynı seviyede

Bu arada OpenAI'ın en büyük rakiplerinden Google'ın geliştirdiği yapay zeka araçları da özellikle tıp alanında adından sıkça söz ettiriyor.

Şirketin sıkça sorulan tıbbi soruları yanıtlaması için geliştirdiği Med-PaLM adlı sohbet aracının cevaplarıyla doktorların yanıtları hemen hemen aynı oranda doğru çıktı.

Sohbet botuna sorular yönelten bir grup araştırmacı, gelen yanıtların yüzde 92,6’sının doğru olduğunu kaydetti. Aynı sorular bir de doktorlara yöneltilince onlardan gelen yanıtların da yüzde 92,9 oranında tatmin edici olduğu görüldü.

Bilimsel makalelerde yazar olmaya başladı

Bilim dünyasının önemli bir bölümü ChatGPT gibi dil algoritmalarını kabullenmeye şimdiden hazır. Bilimsel dergi editörleri, araştırmacılar ve yayıncılar artık bu tür araçları yazar olarak kabul etmenin ve onlardan alıntı yapmanın uygun olup olmadığını tartışıyor.

İsveçli araştırmacı Almira Osmanoviç Thunstrom, Temmuz 2022'de GPT-3'le ilgili bir akademik makale hazırlamıştı. Hakem onayına sunulan makalede GPT-3'ün kendisi de yazar olarak yer almıştı. Öte yandan, "GPT-3, asgari düzeyde insan girdisiyle kendi başına akademik bir makale yazabilir mi?" başlıklı makale halen hakem onayından geçmedi.

Nurse Education in Practice adı bilimsel dergide bu ay yayımlanan bir başyazıda da ChatGPT'nin, Birleşik Krallık Manchester Üniversitesi'nden Siobhan O'Connor'la birlikte ortak yazar olduğu görüldü. Ancak derginin baş editörü Roger Watson, bu durumun gözden kaçtığını ve yakında düzeltileceğini açıkladı.

Bunun yanı sıra Hong Kong merkezli ilaç keşif şirketi Insilico Medicine'in CEO'su Alex Zhavoronkov da ChatGPT'yi geçen ay Oncoscience adlı bilimsel dergide yayınlanan bir makalenin ortak yazarı olarak gösterdi. Zhavoronkov, ChatGPT'nin önceki nesil yapay zeka araçlarından çok daha iyi yazdığını belirtiyor.

Bu konuda yayıncılar ve bilim insanları arasında çetin bir tartışma yürüyor. Zira birçok yayıncı, yapay zeka araçlarının yazar olarak görülemeyeceği ve hatta intihal sayılabileceği görüşünde.

Prestijli akademik dergi Science'ın genel yayın yönetmeni Holden Thorp, "Yapay zekanın yayınladığımız bir makalede yazar olarak yer almasına izin vermeyiz" diyor:

"Yapay zeka tarafından üretilen metnin uygun alıntı yapılmadan kullanılması intihal olarak kabul edilir."

Yapay zekalı avukatlara hazır olun

Yapay zeka tartışmasının önemli bir ayağını da hukukçular yürütüyor. Çünkü davaların açılması ve işleme konması gibi işlemlerde yapay zeka teknolojisi bir süredir kullanılıyor. Hatta Çin'in başkenti Pekin'de internet mahkemeleri ve bahsi geçen süreçlerle ilgilenen bir sanal hakim bile var.

Bu arada yapay zeka, ABD'de şubat ayında görülecek bir trafik cezası davasında tarihte ilk kez sanık avukatı olmaya hazırlanıyor. Sanığa duruşma sırasında kulaklık aracılığıyla danışmanlık yapması beklenen araç, mahkemedeki argümanları dinleyecek ve sanığın verebileceği en iyi cevapları analiz edecek. Akıllı telefon üzerinde çalışan teknoloji, sanığın kimliğini gizli tutan DoNotPay adlı bir teknoloji girişimi tarafından tasarlandı.

Teknoloji meraklıları heyecanla bu davanın sonucunu beklerken, uzmanlık yelpazesini genişleten ChatGPT de ABD'deki Baro Sınavı'nın çoktan seçmeli kısmını geçmeyi başardı.

Baro Sınavı, hukuk fakültesi mezunlarının mesleklerini resmen icra edebilmeleri için geçmeleri gereken, üç bölümlü bir sınav. ChatGPT bu sınavın MBE adı verilen ilk bölümünde yüzde 50 başarı elde etti.

ChatGPT'nin rakibi de hukuk ve ekonomi sınavlarından geçer not aldı

Hukuk ve ekonomi sınavlarında önemli dereceler elde eden tek yapay zeka aracı ChatGPT de değil.

Araştırma firması Anthropic'in geliştirdiği Claude AI, sınavı cevaplayanın ismine bakılmadan not verilen bir hukuk ve ekonomi sınavında "ucu ucuna geçer not" alırken, sınavı değerlendirenler bunun "birçok insan adaydan daha iyi" olduğunu söylüyor.

Dikkat çeken deneme, George Mason Üniversitesi'nde yapıldı. Ancak öğretim üyesi Alex Tabarrok, Claude AI'ın en iyi insan öğrencilere kıyasla kayda değer kusurları olduğunu belirtiyor.

GPT-4 karşısında ne yapacağız?

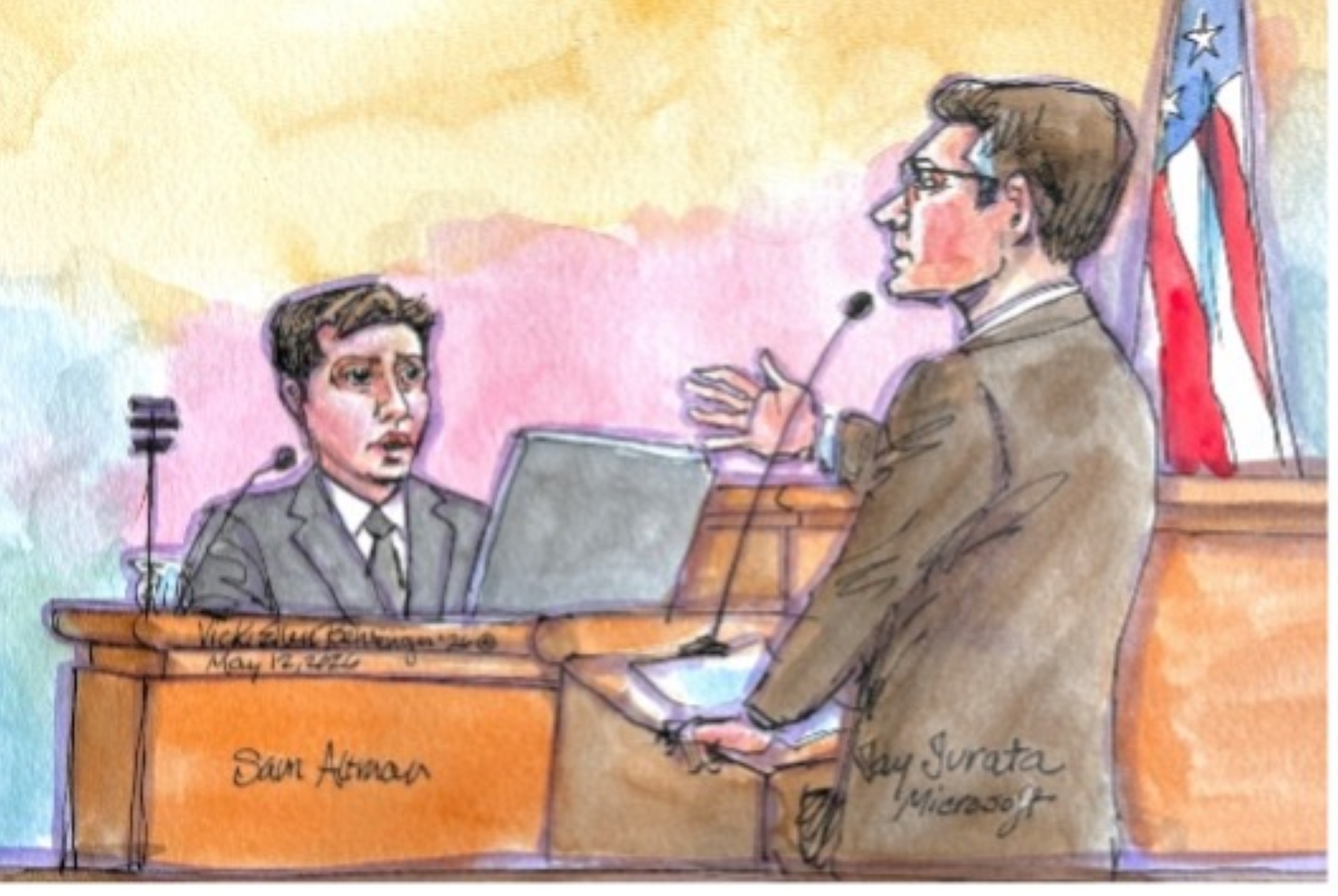

Kısa süre önce Microsoft'la 10 milyar dolarlık anlaşmaya imza atan OpenAI, halihazırda GPT-4 adını verdiği yeni sürüm üzerinde çalışıyor.

ChatGPT'yle ilgili eleştirileri ve geri bildirimleri toplayan firma, GPT-4'ü geliştirirken bunları da göz önüne aldıklarını belirtiyor.

Bu arada GPT-3 karşısında bile dehşete düşmüş olan akademi camiasının, GPT-4 karşısında ne yapacağı da merak konusu.

OpenAI CEO'su Sam Altman ise, GPT-4'ten korkmanın yersiz olduğunu ima ediyor:

"İnsanlar hayal kırıklığına uğramak için yalvarıyor ve uğrayacaklar da. Yapay Genel Zeka seviyesine ulaşmadık ama bizden bekledikleri bu."

Yapay genel zeka (YGZ), bir insanın yapabileceği herhangi bir zihinsel görevi başarıyla gerçekleştirebilecek varsayımsal makineler için kullanılan bir niteleme.

Önde gelen yapay zeka araştırmacıları, YGZ'nin ortaya çıkmasının insanlık için varoluşsal bir felaketle sonuçlanabileceğini düşünüyor.

Yararlanılan kaynaklar: Financial Times, Livemint, Futurism, VICE News, The Verge, Nature, StrictlyVC