Suudi Arabistan’da dijital egemenlik artık yalnızca verilerin nerede depolandığıyla ilgili bir mesele olmaktan çıkarken, değişen koşullar karşısında altyapı, modeller, operasyonlar, anahtarlar ve dijital tedarik zincirleri üzerindeki kontrolün kimin elinde olduğu sorusunu da kapsayan daha geniş bir kavrama dönüşüyor. Bu konu, dijital dönüşüm gündeminin hız kazandığı ve Suudi Arabistan’ın yapay zekâ, bulut altyapıları, operasyonel dayanıklılık ve yönetişim alanlarındaki hedeflerini büyüttüğü bir dönemde, IBM tarafından Suudi Arabistan’da dijital egemenlik konusunda düzenlenen yuvarlak masa toplantısının ana gündem maddesini oluşturdu.

IBM Suudi Arabistan Bölge Başkan Yardımcısı Eymen er-Raşid (IBM)

IBM Suudi Arabistan Bölge Başkan Yardımcısı Eymen er-Raşid (IBM)

Farkındalık ve hazırlık arasındaki uçurum

Suudi Arabistan pazarına ilişkin verilere göre IBM, Suudi yöneticilerin yüzde 90’ının yapay zekâ egemenliğinin 2026 yılı iş stratejilerinin bir parçası olması gerektiğine inandığını belirtiyor. Ancak toplantıda yapılan değerlendirmelerde, fiilen hazırlıklı olan kurumların oranının bunun oldukça altında kaldığına dikkat çekildi. Katılımcılar, Suudi Arabistan’daki müşterilerin yalnızca ‘her on kurumdan iki ya da üçünün’ yeterli hazırlık düzeyine sahip olduğunu ifade etti.

IBM Suudi Arabistan Bölge Başkan Yardımcısı Eymen er-Raşid, konunun artık teorik ya da geleceğe ertelenmiş bir tartışma olmaktan çıktığını ve ‘bugün yaşanan bir tartışma’ hâline geldiğini söyledi. Raşid, sorunun farkındalık eksikliğinden değil, egemenliğin stratejinin bir parçası olması gerektiğine inanmakla bunu uygulayabilecek kapasiteye sahip olmak arasındaki farktan kaynaklandığını belirtti. Birçok kurumun hâlâ dijital egemenlik meselesine geleneksel bir bakış açısıyla yaklaştığını kaydeden Raşid, tartışmanın “Veriler nerede bulunuyor? Hesaplama altyapısı nerede?” sorularının çok ötesine geçtiğini vurguladı.

IBM Institute for Business Value tarafından Suudi Arabistan’a ilişkin yayımlanan sonuçlara göre, Suudi liderlerin yüzde 63’ü bilişim kaynaklarının temininde belirli bölgelere bağımlı olmaktan endişe duyuyor. Bu oran, küresel ortalamanın üzerinde bulunuyor. Ayrıca liderlerin yüzde 85’i jeopolitik ve ekonomik gelişmelerin teknoloji yatırımlarını tehdit ettiğini düşünüyor. Buna karşılık, Suudi liderlerin yüzde 73’ü ise kurumların uyum sağlama kapasitesine sahip olması halinde jeopolitik dalgalanmaların 2026 yılında yeni iş fırsatları yaratabileceğine inanıyor.

IBM, Suudi kuruluşların yapay zekanın önemine ilişkin farkındalığı ile bunu uygulamaya yönelik fiili hazırlıkları arasında bir uçurum olduğunu düşünüyor. (Shutterstock)

IBM, Suudi kuruluşların yapay zekanın önemine ilişkin farkındalığı ile bunu uygulamaya yönelik fiili hazırlıkları arasında bir uçurum olduğunu düşünüyor. (Shutterstock)

Egemenlik sadece bir konum değil

Şarku’l Avsat’ın katıldığı oturumda konuşan Sabine Holl, dijital egemenlik kavramının düzenleyici bir gereklilik olmaktan çıkarak stratejik bir önceliğe dönüştüğünü söyledi. IBM’in Ortadoğu ve Afrika Bölgesi Satış Mühendisliği Başkan Yardımcısı ve Teknoloji Direktörü olan Holl, tartışmaların başlangıçta veri egemenliği ekseninde yürüdüğünü, yani verilerin ülke içinde mi yoksa dışında mı bulunduğu sorusuna odaklandığını belirtti. Ancak son dönemde veri merkezlerinde yaşanan kesintiler ve jeopolitik gerilimler gibi gelişmelerin, fiziksel konumun tek başına kontrolü garanti etmeye yetmediğini ortaya koyduğunu ifade etti.

Holl, dijital egemenliğin artık ‘veriler, altyapı ve teknoloji geliştirme süreçleri’ üzerindeki kontrolle bağlantılı hale geldiğini söyledi. Bu çerçevede IBM, dijital egemenlik kavramını operasyonel egemenlik, veri egemenliği, teknoloji egemenliği ve yapay zekâ egemenliği olmak üzere dört temel başlık altında ele alıyor. Bu yaklaşım doğrultusunda dijital egemenlik, yalnızca verilerin yerel sınırlar içinde tutulmasına yönelik düzenlemelere uyum anlamına gelmiyor; aynı zamanda verilere kimin erişebildiğini, sistemi kimin yönettiğini, modellerin nerede çalıştığını ve kurumların gerektiğinde uyumluluğunu nasıl kanıtlayabildiğini kapsayan sürekli bir yetkinlik olarak tanımlanıyor.

Konuyu doğrudan bir ifadeyle özetleyen Holl, “Egemenlik yalnızca konumla ilgili değildir” dedi. Holl’e göre temel soru, verilerin yerel bir veri merkezinde bulunup bulunmadığından ziyade, bu veriler üzerinde kimin kontrol sahibi olduğu, hangi kimliklerle şifrelerinin çözülebildiği ve bölgesel bir kesinti ya da beklenmedik bir kriz durumunda kurumun iş sürekliliğini sağlayacak bir kurtarma ve operasyon planına sahip olup olmadığıyla ilgili.

Yapay zekâ denklemi karmaşıklaştırıyor

Dijital egemenlik konusu, yapay zekânın yaygınlaşmasıyla birlikte daha da karmaşık bir hâl alıyor. Zira yapay zekâ modelleri ve ajanları artık yalnızca verileri depolamak veya okumakla yetinmiyor; farklı veri kaynaklarına erişebiliyor, bilgileri yorumlayabiliyor, karar önerilerinde bulunabiliyor ve hatta kurumların sistemleri içinde çeşitli işlemleri doğrudan gerçekleştirebiliyor. Bu durum, dijital egemenlik tartışmasına yeni bir boyut kazandırıyor: Kurumlar yalnızca verilerin bulunduğu yer üzerinde mi kontrol sahibi, yoksa yapay zekânın bu verilerle ne yaptığı üzerinde de denetim sağlayabiliyor mu?

Bu yaklaşım, IBM’in ‘yapay zekâ için yeni işletim modeli’ olarak tanımladığı yapıya neden önem verdiğini de ortaya koyuyor. Şirkete göre yapay zekâ alanında öne çıkan kurumlar sadece daha fazla araç kullanmakla kalmıyor, aynı zamanda çalışma biçimlerini de yeniden tasarlıyor. IBM, bu modelin birbiriyle bağlantılı üç temel unsur üzerine kurulduğunu belirtiyor: yapay zekâ ajanları, veri, otomasyon ve hibrit altyapılar.

Bu çerçevede IBM, farklı ortamlarda yapay zekâ ajanlarının koordinasyonu ve yönetimi için geliştirilen yeni nesil Watsonx Orchestrate çözümünü duyurdu. Şirket ayrıca gerçek zamanlı veri yetenekleri için Confluent ve watsonx.data entegrasyonlarının yanı sıra, akıllı operasyonlar için IBM Concert platformunu ve operasyonel egemenlik alanındaki IBM Sovereign Core çözümünü tanıttı.

Oturum sırasında Şarku’l Avsat, yapay zekâ ajanlarının kurumsal iş akışlarının bir parçası haline gelmesiyle birlikte dijital egemenliğin daha zor yönetilen bir konuya dönüşüp dönüşmediğini gündeme getirdi. Soruda, verilerin artık yalnızca depolanmadığı; kullanıldığı, yorumlandığı ve bunlara dayanarak kararlar alındığı vurgulandı. Bu soruya yanıt veren Holl, kurumların artık ajanların ‘her yerde’ bulunduğu bir gerçeklikle karşı karşıya olduğunu söyledi. Holl, bu ajanların hem kurum içi sistemlerde hem de farklı platformlarda faaliyet gösterebildiğini belirterek, bu nedenle güçlü gözetim ve denetlenebilirlik mekanizmalarına ihtiyaç duyulduğunu ifade etti. Holl ayrıca, IBM tarafından geliştirilen işletim modelinin önemli unsurlarından birinin de, yapay zekâ ajanlarının yönetilmesini ve izlenmesini sağlayan ‘ajan kontrol katmanı’ olduğunu kaydetti.

IBM, yapay zekadan gerçek bir değer elde etmenin temel unsurlarının insan becerileri ve sistemlere duyulan güven olduğunu vurguluyor. (Shutterstock)

IBM, yapay zekadan gerçek bir değer elde etmenin temel unsurlarının insan becerileri ve sistemlere duyulan güven olduğunu vurguluyor. (Shutterstock)

Buluttan operasyonel özerkliğe

IBM, hibrit bulut stratejisinin dijital egemenliğin inşasında temel unsurlardan biri haline geldiğini değerlendiriyor. Oturumda konuşan Holl, bulut teknolojilerinin yaygınlaşmasının egemenlik kavramına bakışı değiştirdiğini belirtti. Holl, özellikle Ortadoğu ve Afrika’da veriye erişim ve verinin kullanımına ilişkin düzenlemelerin erken dönemde ortaya çıkmasının, şirketlerin konuya yaklaşımını şekillendirdiğini ifade etti. Bu durumun, IBM’in hibrit bulut stratejisinin oluşumunda etkili olduğunu kaydeden Holl, bulutun sunduğu avantajların yalnızca genel bulut ortamlarıyla sınırlı kalmaması; özel bulut ve kurum içi sistemlerde de uygulanabilmesi gerektiğini söyledi.

Holl, geçmişte ‘her şeyin buluta taşınacağı’ yönündeki beklentinin tam anlamıyla gerçekleşmediğini dile getirdi. Kurumların hibrit ve çoklu bulut ortamlarında faaliyet göstermeyi sürdürdüğünü belirten Holl, ancak bu yapılarda çoğu zaman yeterli şeffaflık, denetlenebilirlik ve kontrol mekanizmalarının bulunmadığını ifade etti. Holl’e göre bir kurum, ‘tek bir tuşla’ sistemlerin nerede çalıştığı, kim tarafından yönetildiği ve düzenleyici gerekliliklere uygun olup olmadığı gibi sorulara yanıt veremiyorsa, gerçek anlamda dijital egemenliğe sahip sayılmıyor.

Bu noktada IBM, ‘tasarım yoluyla egemenlik’ kavramını öne çıkarıyor. Holl, mevcut bir teknolojik ortamın sonradan çeşitli eklemelerle egemen bir yapıya dönüştürülemeyeceğini savundu. Bunu, gölde kullanılan küçük bir teknenin basit onarımlarla okyanusu aşabilecek ve fırtınalara dayanabilecek bir gemiye dönüştürülemeyeceği benzetmesiyle açıklayan Holl, dijital egemenliğin altyapının tasarım aşamasından itibaren gözetilmesi gerektiğini vurguladı. Buna göre taşınabilirlik, tercih özgürlüğü, açık platformlar, felaket kurtarma planları, şifreleme anahtarlarının kontrolü ve kimlik yönetimi gibi unsurlar, sistem mimarisinin başlangıçtan itibaren ayrılmaz parçaları olmalı.

Egemenliği işleyişe dönüştürme girişimi

IBM, IBM Sovereign Core platformunun dijital egemenliği yalnızca yazılı bir politika olmaktan çıkararak uygulanabilir ve doğrulanabilir bir yapıya dönüştürmeyi hedeflediğini belirtiyor. Şirket, söz konusu platformu; hükümetlerin, kurumların ve hizmet sağlayıcılarının yapay zekâya hazır egemen dijital ortamlar oluşturmasına yardımcı olan, aynı zamanda hibrit sistemlerde kontrol ve mevzuata uyumun kanıtlanabilmesini sağlayan bir çözüm olarak tanımlıyor.

IBM’in yazılımdan sorumlu kıdemli başkan yardımcısı Dinesh Nirmal, yapay zekânın dijital egemenliği ‘siyasi bir söylemden ziyade çalışma anında karşılanması gereken bir gerekliliğe’ dönüştürdüğünü ifade etti. Öte yandan Raşid, yapay zekânın kurumsal ve ulusal stratejilerin ayrılmaz bir parçası haline gelmesiyle birlikte kurumların, operasyonel yetkiyi, güveni ve düzenleyici gereklilikleri riske atmadan yenilik yapabilme ihtiyacının arttığını söyledi.

Platform; müşteri tarafından yönetilen bir kontrol katmanı, kimlik hizmetleri, şifreleme altyapısı, egemen sınırlar içinde tutulan veriler, sürekli uyumluluk takibi ve otomatik denetim kayıtları üretimi gibi çeşitli özellikler içeriyor. Ayrıca önceden tanımlanmış düzenleyici çerçeveler ile yapay zekâ modellerinin, çıkarım süreçlerinin ve yapay zekâ ajanlarının belirlenmiş egemenlik sınırları içinde kontrollü biçimde çalıştırılmasını sağlıyor. IBM Sovereign Core, açık teknolojilere dayalı bir mimari üzerine inşa edilmiş durumda. Platform, Red Hat OpenShift ve Red Hat AI çözümlerinden yararlanırken; AMD, Dell, Mistral, MongoDB ve Palo Alto Networks gibi şirketleri kapsayan geniş bir iş ortaklığı ekosistemi tarafından destekleniyor.

Oturumda konuşan Holl ise dijital egemenlik yaklaşımının her kurumun kendi sunucusunu ya da yerli bir çip üretmesini gerektirmediğini vurguladı. Holl’e göre asıl önemli olan, koşullar değiştiğinde kurumların farklı bileşenler ve çalışma ortamları arasında geçiş yapabilme özgürlüğüne sahip olması. Holl, grafik işlem birimleri (GPU), bellek ve yarı iletken tedarikinde yaşanabilecek darboğazların, kurumların tek bir tedarikçiye veya değiştirilemeyen bir altyapıya bağımlı kalması durumunda ciddi bir egemenlik riskine dönüşebileceği uyarısında bulundu.

Yapay zekâ aracılarının yaygınlaşması, verilerin çoklu sistemler içinde kullanılması, yorumlanması ve bunlara dayalı olarak kararların alınması nedeniyle egemenliği daha karmaşık hale getiriyor.

Yapay zekâ aracılarının yaygınlaşması, verilerin çoklu sistemler içinde kullanılması, yorumlanması ve bunlara dayalı olarak kararların alınması nedeniyle egemenliği daha karmaşık hale getiriyor.

Esneklik, egemenliğin bir parçası

Tartışmada öne çıkan başlıklardan biri de dijital egemenlik ile operasyonel dayanıklılık arasındaki yakın ilişki oldu. Katılımcılara göre bir kurum, hizmet kesintisi, siber saldırı veya jeopolitik kriz gibi durumlarda faaliyetlerini sürdüremiyor ve hızlı şekilde toparlanamıyorsa, sahip olduğunu düşündüğü kontrolü fiilen elinde bulundurmuyor demektir. Holl, bazı yedekleme ve felaket kurtarma stratejilerinin başarısız olmasının temel nedeninin, bunların yeterince ciddi biçimde test edilmemesi veya operasyonel bir zorunluluktan ziyade ikincil bir tercih olarak görülmesi olduğunu söyledi.

Suudi Arabistan’da dijital dönüşümün kamu, enerji, finans, telekomünikasyon ve sağlık gibi kritik sektörlerde hız kazanmasıyla birlikte bu konu daha da önem kazanıyor. Katılımcılar, özellikle kamu kurumlarının artık yalnızca politika ve düzenlemelerin tamamlanmasını beklemekle yetinmediğini, aynı zamanda iş yüklerini egemenlik ilkelerine uygun hizmet sağlayıcılarına taşımaya veya dijital ortamları yöneten ekiplerin ülke içinde bulunmasını sağlamaya yönelik somut adımlar attığını ifade etti.

Egemenlik ve insan becerileri

Tartışmalar yalnızca teknolojiyle sınırlı kalmadı. Raşid, dijital egemenlik kavramını insan kaynağıyla da ilişkilendirerek, yapay zekânın gerçek değerinin ancak gerekli beceriler ve sistemlere duyulan güvenle ortaya çıkabileceğini vurguladı. Raşid, “İnsan becerileri, yapay zekâ ekonomisinin para birimidir” ifadesini kullanarak, bazı kurumların yapay zekâ çözümlerini devreye almasına rağmen beklenen faydayı elde edemediğini; bunun temel nedeninin kullanıcıların söz konusu sistemlere yeterince güvenmemesi veya onlardan etkin şekilde yararlanabilecek yetkinliklere sahip olmaması olduğunu söyledi.

Bu yaklaşım, Suudi Arabistan’da yürütülen dijital egemenlik tartışmalarına yeni bir boyut kazandırıyor. Buna göre egemenlik, yalnızca veri merkezlerine veya bulut platformlarına kimin sahip olduğu meselesi değil; aynı zamanda bu sistemleri kimin işlettiği, riskleri kimin anlayabildiği, uyumluluğu kimin kanıtlayabildiği ve kuralların, piyasaların ya da tehditlerin değişmesi durumunda stratejiyi kimin yeniden şekillendirebildiğiyle de yakından bağlantılı.

IBM’in 2026 eğilimlerine ilişkin raporuna göre, Suudi Arabistan’daki üst düzey yöneticilerin yüzde 88’i, yapay zekâ ajanlarının belirsizlik ve kriz dönemlerinde daha hızlı ve daha isabetli kararlar alınmasına yardımcı olduğuna inanıyor. Ancak bu iyimser tablo, kurumların önüne yeni bir sorumluluk da çıkarıyor. Zira yapay zekâ ajanlarının karar alma süreçlerine katkısı ve görevleri yerine getirme kapasitesi arttıkça; açık yönetişim mekanizmalarına, denetim süreçlerine, model ve ajan yaşam döngüsünün etkin yönetimine, ayrıca gerektiğinde istenilen performansı göstermeyen sistemlerin durdurulmasına veya yeniden yapılandırılmasına duyulan ihtiyaç da artıyor.

Dijital egemenlik, operasyonel esneklik ve arızalardan, jeopolitik krizlerden ve siber saldırılardan kurtulma yeteneği gerektirir. (Shutterstock)

Şekillenmekte olan bir Suudi modeli

Holl’e göre Suudi Arabistan, dijital egemenlik tartışmalarında özel bir konuma sahip bulunuyor. Holl, Suudi Arabistan’ın yerel veri merkezleri kurarken aynı zamanda küresel bulut sağlayıcılarıyla iş birliği yaparak ileri teknolojileri ülke içine taşıyan bir model geliştirdiğini belirtti. Bu yaklaşımın, yerel düzenlemelerle uyumlu bir çerçeve içinde inovasyonu mümkün kıldığını ifade etti. Ancak mevcut veriler, Suudi Arabistan’da bilişim altyapıları, yarı iletkenler ve küresel teknoloji sağlayıcılarına dış bağımlılık konusunda duyulan endişenin dünya ortalamasının üzerinde olduğunu da ortaya koyuyor.

Bu nedenle tartışma, tam anlamıyla içe kapanma ile sınırsız dışa açılma arasında bir tercih yapmaktan ziyade; küresel inovasyona erişim ile yerel kontrol arasında denge kurabilecek bir modelin nasıl oluşturulacağı sorusuna odaklanıyor. Bu model; yerel denetimin korunmasını, mevzuata uyumun kanıtlanabilmesini ve yapay zekâ sistemlerinin belirli sınırlar içinde işletilebilmesini hedefliyor. Bu çerçevede dijital egemenlik, yalnızca hukuki veya düzenleyici bir başlık olmaktan çıkarak dijital ekonominin operasyonel altyapısının temel bileşenlerinden biri haline geliyor.

Yapay zekânın deneysel uygulamalardan gerçek operasyonlara, modellerden otonom ajanlara doğru evrilmesiyle birlikte, oturumda gündeme getirilen temel soru Suudi kurumları açısından daha da kritik bir önem kazanıyor: Kurumlar yalnızca verilerini ülke sınırları içinde tutuyor olmalarıyla mı yetinmeli, yoksa bu veriler üzerinde gerçekleşen tüm süreçleri yönetebilecek kapasiteye de sahip olmalı mı? Verileri kim kullanıyor, yapay zekâ modelleri ve ajanları hangi kurallarla çalışıyor ve koşullar değiştiğinde sistemler nasıl uyum sağlıyor? Dijital egemenlik tartışmasının merkezinde artık bu sorular yer alıyor.

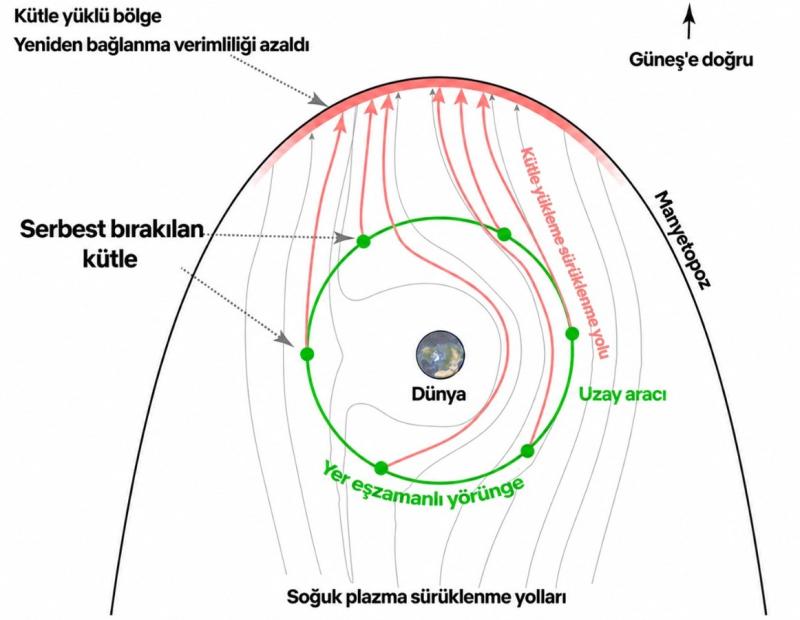

Güneş süper fırtınasının Dünya'nın plazmasferini sıkıştırması (Uzay-Dünya Çevre Araştırmaları Enstitüsü / Nagoya Üniversitesi)

Güneş süper fırtınasının Dünya'nın plazmasferini sıkıştırması (Uzay-Dünya Çevre Araştırmaları Enstitüsü / Nagoya Üniversitesi) Yeni konseptin şematik diyagramı (Space Weather)

Yeni konseptin şematik diyagramı (Space Weather)

IBM Suudi Arabistan Bölge Başkan Yardımcısı Eymen er-Raşid (IBM)

IBM Suudi Arabistan Bölge Başkan Yardımcısı Eymen er-Raşid (IBM) IBM, Suudi kuruluşların yapay zekanın önemine ilişkin farkındalığı ile bunu uygulamaya yönelik fiili hazırlıkları arasında bir uçurum olduğunu düşünüyor. (Shutterstock)

IBM, Suudi kuruluşların yapay zekanın önemine ilişkin farkındalığı ile bunu uygulamaya yönelik fiili hazırlıkları arasında bir uçurum olduğunu düşünüyor. (Shutterstock) IBM, yapay zekadan gerçek bir değer elde etmenin temel unsurlarının insan becerileri ve sistemlere duyulan güven olduğunu vurguluyor. (Shutterstock)

IBM, yapay zekadan gerçek bir değer elde etmenin temel unsurlarının insan becerileri ve sistemlere duyulan güven olduğunu vurguluyor. (Shutterstock) Yapay zekâ aracılarının yaygınlaşması, verilerin çoklu sistemler içinde kullanılması, yorumlanması ve bunlara dayalı olarak kararların alınması nedeniyle egemenliği daha karmaşık hale getiriyor.

Yapay zekâ aracılarının yaygınlaşması, verilerin çoklu sistemler içinde kullanılması, yorumlanması ve bunlara dayalı olarak kararların alınması nedeniyle egemenliği daha karmaşık hale getiriyor.